BestBlogs.dev 精选文章 第 16 期

立即订阅亲爱的读者朋友们,

👋 欢迎阅读本期 BestBlogs.dev 的精选文章推送!

🚀 本期我们聚焦 AI 领域的最新突破、创新应用和行业动态,为您呈现模型进展、开发工具、产品创新和市场策略的精华内容。让我们一起探索 AI 的前沿发展!

🧠 AI 模型与技术:性能突破,能力升级

- xAI 发布 Grok-2 大模型,性能紧随 GPT-4o,在编码和复杂问题解决方面表现出色。

- 智谱推出 GLM-4-Long,支持 1M 上下文长度,价格极具竞争力,适用于长文档处理场景。

- 面壁智能的 MiniCPM-V 2.6 在多模态任务上取得 SOTA 成绩,首次在端侧实现实时视频理解和多图联合理解。

💻 AI 开发与工具:效率提升,成本降低

- Claude、谷歌等推出长文本缓存功能,大幅降低处理长文本的成本,最高可节省 90%。

- TensorFlow Lite 在边缘设备上优化 LLM 推理,提高性能和能效比。

- GitHub 推出 Copilot Autofix,将代码安全修复速度提高三倍,显著提升开发效率。

🎯 AI 产品与应用:创新落地,体验升级

- 谷歌发布 Gemini Live,展示 AI 在移动设备上的对话体验和多应用集成能力。

- Cosine 公司推出 Genie AI 工程师,能自主完成代码编写、bug 修复等任务,性能领先同类产品。

- AI 技术在新闻媒体、教育、儿童陪伴等领域引发变革,影响内容创作、学习体验和用户交互方式。

🌐 AI 行业动态:机遇与挑战并存

- 业内专家预测 AI 可能带来十倍于移动互联网的机会,但也面临技术泡沫、数据安全等挑战。

- AI 硬件(如 AI 眼镜)和具身智能成为新的研究热点,预计在未来几年内迎来爆发式增长。

- 混合专家模型(MoE)成为提升模型效率的热点研究方向,有望解决大模型计算资源问题。

🔗 想深入了解这些主题?点击阅读原文,获取更多精彩内容!

目录

- Grok-2 来了,能生图识图、性能比肩 GPT-4o,马斯克:发展猛如火箭

- 大模型降价又来新玩家——Claude,长文本缓存功能,最高节省 90% 成本

- GLM-4-Long:长、无损、理解复杂语义、更便宜

- 猎鹰曼巴:首个无注意力机制的强大 7B 模型

- 一文揭秘|预训练一个 72b 模型需要多久?

- OpenAI 爆料者竟然是智能体?斯坦福系创企推出新一代智能体 AgentQ

- 社区供稿 | 仅 8B,全面对标 GPT-4V !单图、多图、视频理解端侧三冠王!

- 清华唐杰团队新作:一口气生成 2 万字,大模型开卷长输出

- Midjourney 也得「站着敬酒」,AI 图片生成新王 Flux 怎么这么强?

- 比 Stable Diffusion 便宜 118 倍!1890 美元训出 11.6 亿参数高质量文生图模型

- 更高效的 RAG 文本检索和排序: 多语言 GTE 系列模型开源

- 从 ACL 2024 录用论文看混合专家模型(MoE)最新研究进展

- 将 AI 可视化进行到底 | 把 LLM 原理压缩成 5 秒动图!SD 文生图全流程 gif;Prompt 可视化最新玩法;清华最全 AI 术语清单…

- Dify v0.7.0:会话变量 & 变量赋值节点 - 实现 LLM 应用的精准记忆功能

- Meta 如何大规模地为 AI 生成的图像制作动画

- 基于长上下文的检索增强生成性能

- 通过 QnABot,一个生成式 AI 聊天机器人,提供出色的对话体验来愉悦您的客户

- 什么是 AI 代理,它们为什么重要?

- 边缘推理优化:TensorFlow Lite 的 LLM 推理加速

- InfoQ 2024 年 AI、ML 和数据工程趋势

- 谷歌云 AI 夏季学习课程推荐

- 一夜之间,谷歌版 GPT-4o 和 AI 手机全上市了

- 研究了 44 个 AI 产品,我发现了 AI 应用定价的秘密

- 当语言无法描述:为超越对话式界面的人工智能设计

- OpenAI 已投,大厂高管涌入,儿童陪伴正成为 AI 应用的下一个风口

- 代理的用户体验,第三部分:电子表格、生成式和协作式 UI/UX

- 2000 万用户,Gamma 创始人:PPT 是痛点,但产品好才能解决痛点

- 全球最强 AI 程序员:GPT-4o 加持,需求到跑通只需 84 秒

- 腾讯混元文生图开源模型上线三款 ControlNet 插件,让你精准控图

- 社区供稿 | 开源 AI 视频工具,你只需要当导演,Hugging Face 工程师打造

- 爆火毒舌 AI 每小时赚 2.8 万!每分钟 36 个新用户,火遍全球只因改了一句提示词

- 发现即修复:Copilot Autofix 使安全代码速度提升三倍

- 对话 AI 教育从业者们:AI 如何解决因材施教的难题?

- AI 应用企业落地方法论:践行财务共享 AI 审单项目(第二篇)

- “创业一年,人间三年”,李沐亲述 LLM 创业第一年的进展、纠结和反思

- 3 万字圆桌实录:AI 崛起,新闻长存|仲夏六日谈

- 对谈汪华:AI 有 50% 几率成就十倍移动互联网的机会

- 张鹏对话夏勇峰:使用时长超过 5 小时的 AI 硬件,才能留在牌桌上

- 3 万字圆桌实录:有关具身智能的 10 个真问题|仲夏六日谈

- 谷歌前 CEO 埃里克·施密特最新论 AI 崛起, 全球竞争与科技演变· 万字全文(附视频)

- 红杉资本合伙人 David Cahn 八月访谈 3 万字完整版(附视频)

- C.AI 卖身真相:好技术,好方向,「坏」产品

Grok-2 来了,能生图识图、性能比肩 GPT-4o,马斯克:发展猛如火箭

xAI 在北京时间周三下午正式发布了 Grok-2 大模型,这是继 Grok-1.5 之后的又一重大进步。Grok-2 在 Chatbot Arena 的 LMSYS 榜上表现优异,紧随 GPT-4o 之后,位列第四,超越了 Claude 3.5 Sonnet 和 GPT-4-Turbo。该模型在编码、复杂问题解决和数学领域显示出卓越性能。Grok-2 包括两个版本:Grok-2 和 Grok-2 mini,目前已在 X 平台上向 Grok 用户发布,特别是 X Premium 和 Premium+ 用户。此外,Grok-2 在多模态任务如视觉数学推理和基于文档的问答方面也表现出色。xAI 还计划通过企业 API 提供 Grok-2 和 Grok-2 mini,并增强其安全功能,如多因素身份验证。马斯克对 Grok-2 的发展速度表示自豪,形容其“推进速度像坐了火箭”。

大模型降价又来新玩家——Claude,长文本缓存功能,最高节省 90% 成本

Claude 推出的 API 长文本缓存功能允许模型记忆整本书或整个代码库,在后续请求中直接复用,大幅降低处理长文本的延迟和成本。此功能适用于需要频繁处理长文本的场景,如对话扩展、代码自动补全、大型文档处理等。文章对比了不同模型的缓存定价策略,强调了缓存反复读取次数越多,成本节约越显著。值得注意的是,该功能并非 Claude 首创,谷歌的 Gemini、国内的 Kimi 和 DeepSeek 团队也已实现类似技术。

GLM-4-Long:长、无损、理解复杂语义、更便宜

- GLM-4-Long 是一款支持 1M 上下文长度的语言模型,能够处理长达 150-200 万字的文本,适用于翻译长篇文档、分析财报、提取关键信息等多种复杂任务。

- 模型在价格方面极具竞争力,输入输出价格仅为 0.001 元/千 tokens。

- GLM-4-Long 通过多次技术迭代,集成了大量长文本领域的研究成果,具备无损信息处理能力。

- 模型适用于财报解读、科研论文阅读、小说分析等多种应用场景,提高了信息提取和文档总结的质量。

猎鹰曼巴:首个无注意力机制的强大 7B 模型

猎鹰曼巴由阿布扎比技术创新研究院 (TII) 开发,是一个基于曼巴架构的新型 7B 参数模型。该架构利用选择性状态空间模型 (SSLM),克服了传统 Transformer 在处理长序列时需要增加计算和内存成本的限制。猎鹰曼巴独特的設計,包括 RMS 归一化层,使其能够高效地处理任意长度的序列,特别是在单个 24GB A10 GPU 上。该模型已在 5500GT 的数据上进行训练,包括 RefinedWeb 和高质量的技术数据,并在各种基准测试中展现出与现有最先进模型相媲美的性能,尤其是在序列处理任务中。猎鹰曼巴现已集成到 Hugging Face 生态系统中,提供各种 API 和量化选项,供研究和应用使用。

一文揭秘|预训练一个 72b 模型需要多久?

本文详细探讨了预训练一个 72 亿参数的 Qwen2-72B 模型所需的时间、资源和计算能力。文章首先介绍了预训练模型的计算量需求公式,包括数据集 token 数量和模型参数量的影响。接着,详细分析了矩阵乘法在大模型计算中的核心作用,以及 Embedding 层和 Transformer 层的计算量占比。此外,文章还介绍了Qwen2Attention多头注意力机制的实现,强调了滑动窗口注意力和旋转嵌入的使用。最后,文章分析了预训练过程中的关键技术步骤,如旋转位置嵌入、注意力权重计算和输出处理,以及 batch size 对 GPU 性能的影响和反向传播的计算需求,并指出了预训练过程中遇到的挑战和优化解决方案。

OpenAI 爆料者竟然是智能体?斯坦福系创企推出新一代智能体 AgentQ

斯坦福系创企 MultiOn 发布新一代 AI 智能体 Agent Q,结合蒙特卡洛树搜索(MCTS)和直接偏好优化(DPO)算法,以及 AI 自我批评机制,显著提升了智能体在复杂任务中的表现和成功率。Agent Q 在网页操作和实际任务中展示了高达 95.4% 的成功率,在技术架构和性能评估方面取得了突破性进展。

社区供稿 | 仅 8B,全面对标 GPT-4V !单图、多图、视频理解端侧三冠王!

面壁「小钢炮」 MiniCPM-V 2.6 模型是面壁智能推出的新一代端侧多模态模型,以仅 8B 参数实现了单图、多图、视频理解等多模态核心能力的全面超越 GPT-4V。该模型在多个权威评测平台上取得了 SOTA 成绩,包括 OpenCompass、Mantis-Eval 和 Video-MME。MiniCPM-V 2.6 不仅在单图理解上超越了多模态王者 Gemini 1.5 Pro 和新晋顶流 GPT-4o mini,还在多图联合理解和视频理解上实现了开源模型 SOTA,并且超越了 GPT-4V。此外,该模型首次在端侧实现了实时视频理解、多图联合理解、多图 ICL 视觉类比学习、多图 OCR 等功能,极大地提升了端侧模型的多模态能力。MiniCPM-V 2.6 的推出,标志着端侧多模态模型在性能和功能上的重大突破,为端侧 AI 的应用开辟了新的可能性。

清华唐杰团队新作:一口气生成 2 万字,大模型开卷长输出

清华大学的唐杰团队与智谱 AI 合作,针对大模型在长文本生成方面的限制,提出了一种名为 AgentWrite 的新方法,并通过扩展 LLM 输出窗口大小,显著提升了模型的输出长度。研究发现,现有模型输出长度受限的主要原因是训练数据集中缺乏长文本样本。AgentWrite 将超长文本生成任务分解为多个子任务,每个子任务处理其中的一段,从而克服了这一限制。团队还利用 GPT-4o 生成了包含 6000 个长输出样本的数据集 LongWriter-6k,并提出了 LongBench-Write 用于评估模型性能。实验结果显示,使用 AgentWrite 后,GLM-4-9B 等模型的输出长度显著增加,最长可达 2 万字。未来,团队将进一步扩展模型的输出长度和输出质量,并研究如何在不牺牲生成质量的情况下提高效率。

Midjourney 也得「站着敬酒」,AI 图片生成新王 Flux 怎么这么强?

文章详细介绍了由 Black Forest Labs 开发的 AI 图像生成领域的新星——Flux 模型。该模型通过其独特的混合架构和 120 亿参数,在图像细节、提示响应、风格多样性和场景复杂性方面实现了显著提升,尤其是在生成人物图像时展现出高度的真实感和出色的手部图像生成能力。Flux 的开源策略使其能够在多模型平台上广泛使用,进一步推动了其普及和应用。文章还深入探讨了 AI 图像生成领域的竞争态势,包括开源与闭源模型的对比,并分析了 Flux 如何脱颖而出。未来,Black Forest Labs 计划开发文本生成视频模型,这预示着 AI 生成技术的进一步发展。

比 Stable Diffusion 便宜 118 倍!1890 美元训出 11.6 亿参数高质量文生图模型

加州大学尔湾分校等机构的研究人员发表了一篇论文,介绍了如何大幅降低扩散模型的训练成本。他们采用了延迟掩蔽、MoE(混合专家模型)和分层扩展等策略,成功地将一个 11.6 亿参数的扩散模型训练成本降至 1890 美元,与 Stable Diffusion 等模型的训练成本相比,实现了数量级的降低。更重要的是,该模型的生成图像质量仍然保持了较高水平,在 FID 等多个性能指标上表现优异,接近 Stable Diffusion 1.5 和 DALL·E 2。这一突破为更多研究者和开发者打开了训练大型预训练模型的大门,也为未来更低成本、更高性能的 AI 模型研发提供了新的思路。

更高效的 RAG 文本检索和排序: 多语言 GTE 系列模型开源

GTE 多语言系列模型 由通义实验室开源,在检索增强生成(RAG)文本检索和排序任务中表现优异。该系列模型通过改进模型结构和训练方法,解决了传统 BERT 模型的限制,支持长文档处理、多语言支持、弹性向量表示和稀疏向量表示。在多个数据集的评测中,GTE 模型在检索和排序任务上均显示出优于同类模型的性能,同时保持了高效的推理速度。

从 ACL 2024 录用论文看混合专家模型(MoE)最新研究进展

1、DeepSeekMoE :通过增加专家数量和拆分专家,提高专家分化程度,提升模型性能。

2、Dynamic MoE :引入基于阈值的动态路由方法,根据 token 需求动态选择专家,提高计算效率。

3、XMoE :通过拆分专家和基于阈值的路由,在保证性能的前提下,大幅减少专家数量,提高参数效率。

4、HyperMoE :利用超网络生成专家之间的辅助信息,提升模型性能。

5、Expert SparsityPublic :提出专家剪枝和动态专家跳过策略,在推理阶段减少模型大小和计算开销。

6、MixLoRA :将 MoE 模型的专家替换为 LoRA 向量,利用 LoRA 的低秩特性提升模型效率。

7、ESFT :提出一种基于专家打分的微调方法,只微调模型中被特定任务激活的专家,提高微调效率。

将 AI 可视化进行到底 | 把 LLM 原理压缩成 5 秒动图!SD 文生图全流程 gif;Prompt 可视化最新玩法;清华最全 AI 术语清单…

本文通过介绍多个 AI 可视化工具,帮助读者理解 AI 模型的复杂原理。文章重点介绍了 LLM Visualization、Transformer Explainer、Diffusion Explainer 和 CNN Explainer 等可视化工具,这些工具通过交互式图像和动画,使得复杂的 AI 概念更加直观易懂。此外,文章还提到了清华大学的机器学习术语表,提供了 500 多个 AI 术语的分类和翻译资源,进一步增强了学习的深度和广度。

Dify v0.7.0:会话变量 & 变量赋值节点 - 实现 LLM 应用的精准记忆功能

Dify v0.7.0 推出会话变量和变量赋值节点,解决 LLM 应用在记忆管理上的不足,实现更灵活、精确地存储和引用关键信息。会话变量支持多种数据类型,并与变量赋值节点配合使用,可写入或更新信息。这些功能提升了 LLM 应用在生产环境的实际应用能力,并在门诊导诊、对话摘要、数据分析等复杂场景中扩展了应用潜力。

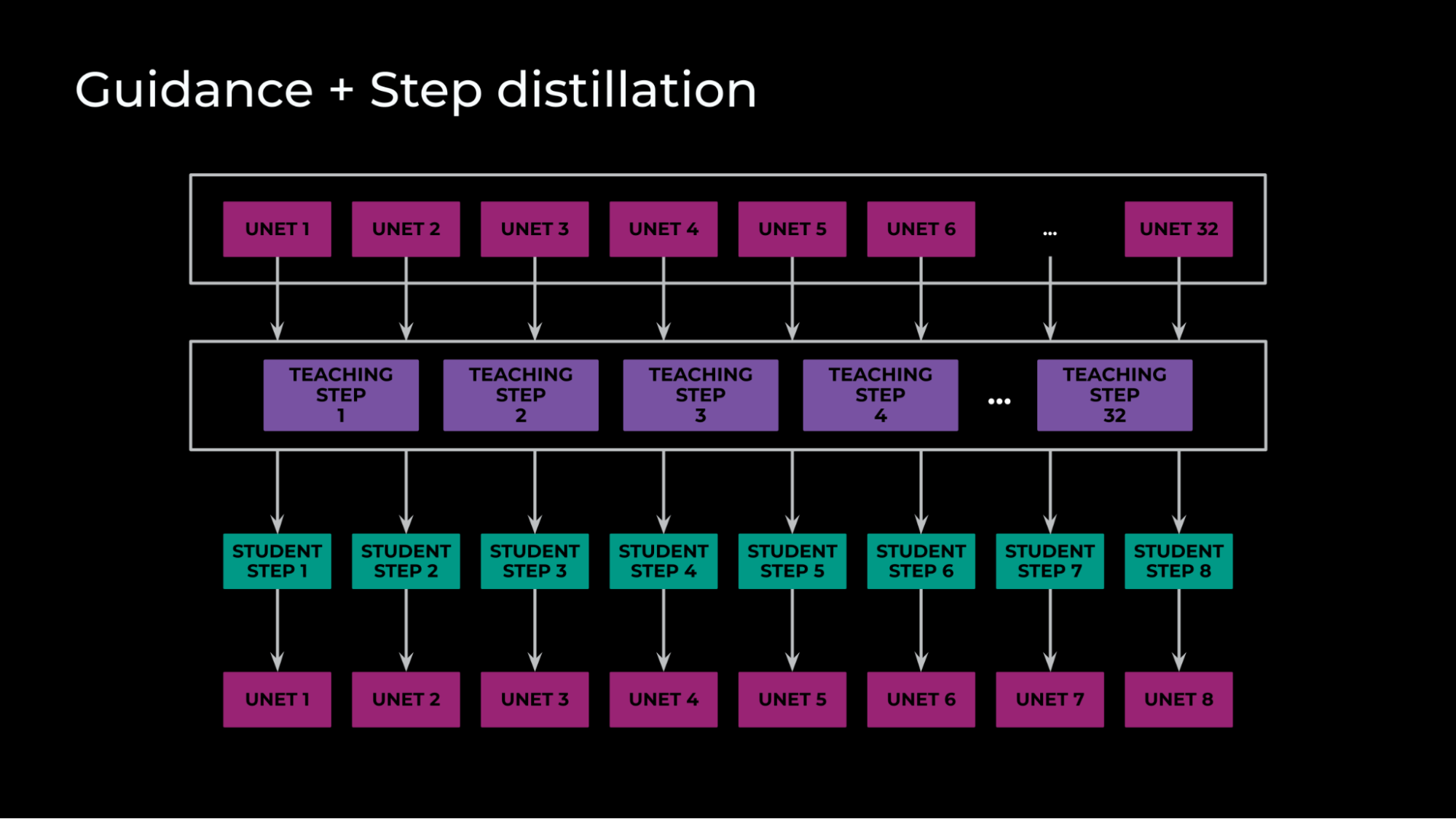

Meta 如何大规模地为 AI 生成的图像制作动画

Meta AI 推出了一个新功能,允许用户从 AI 生成的图像中生成简短的动画,解决了此类服务扩展的挑战。本文详细介绍了用于确保该功能在规模上高效运行的各种优化和技术,为数十亿用户提供快速生成时间和最少的错误。关键优化包括降低浮点精度、改进时间注意力的扩展、利用 DPM-Solver 减少采样步骤、结合指导和步骤蒸馏以及 PyTorch 优化。此外,本文还讨论了部署挑战,例如管理全球流量并确保 GPU 可用于公司内的其他关键任务。通过实施流量管理系统和优化重试设置,Meta AI 实现了图像动画服务的可用性和低故障率。

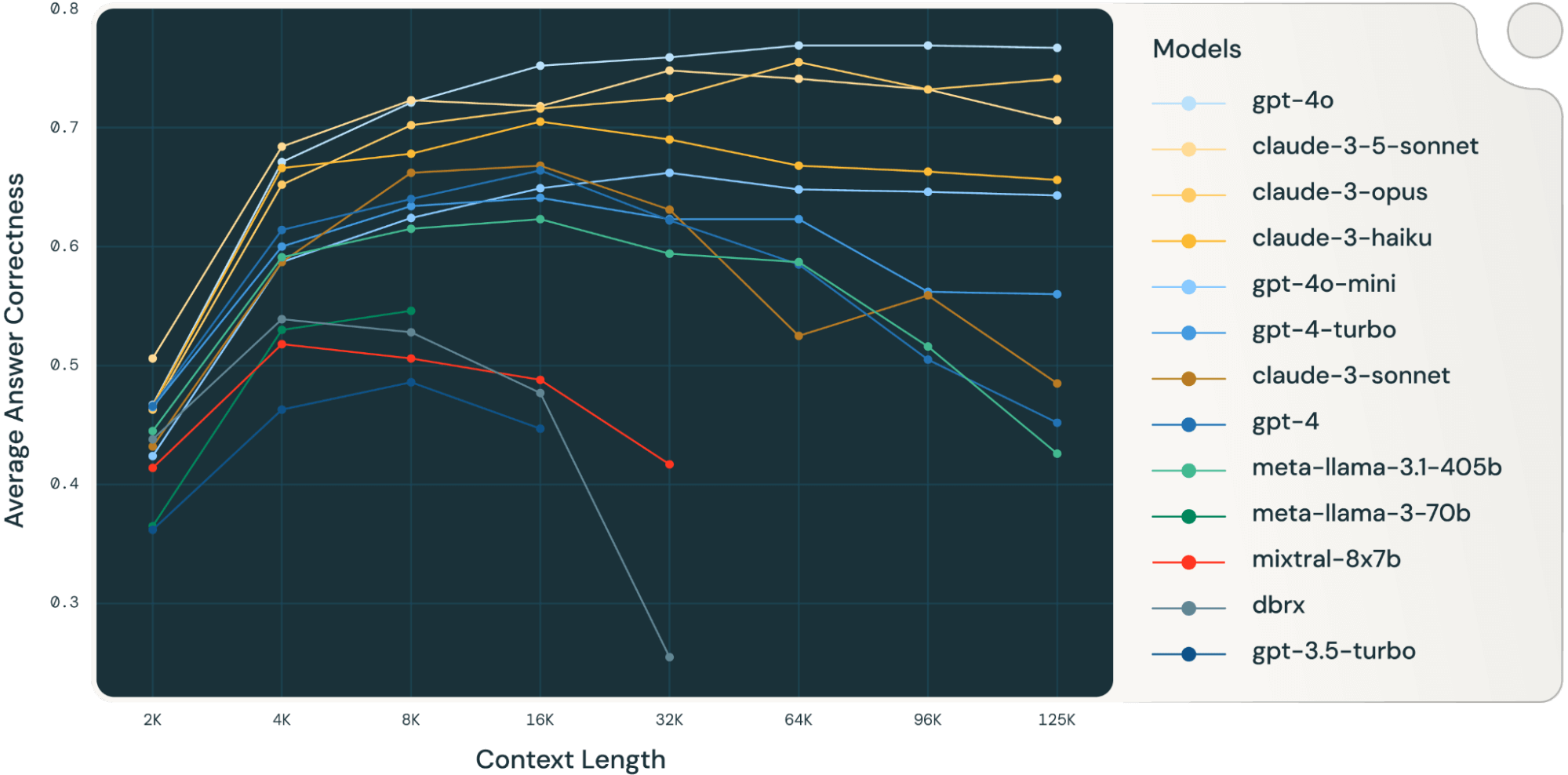

基于长上下文的检索增强生成性能

随着 Anthropic Claude、GPT-4-turbo 和 Google Gemini 1.5 pro 等大语言模型上下文长度的增加,开发者可以将更多文档纳入 RAG 应用程序。我们对 13 个流行的开源和商用大语言模型进行了 2000 多次实验,以评估它们在不同领域特定数据集上的性能。我们发现:

- 检索更多文档通常是有益的: 为给定查询检索更多信息会增加将正确信息传递给大语言模型的可能性,从而提高 RAG 系统性能。具有较长上下文长度的现代大语言模型可以利用这一点,从而提高整体 RAG 系统的性能。

- 较长的上下文并不总是对 RAG 最有利的: 大多数模型的性能在超过一定上下文大小时会下降。值得注意的是,Llama-3.1-405b 的性能在 32k 词元后开始下降,GPT-4-0125-preview 在 64k 词元后开始下降,并且只有少数模型可以在所有数据集上保持一致的较长上下文 RAG 性能。

模型在较长上下文中以不同的方式失败:我们对 Llama-3.1-405b、GPT-4、Claude-3-sonnet、DBRX 和 Mixtral 的较长上下文性能进行了深入研究,并发现了独特的失败模式,例如由于版权问题而拒绝或总是总结上下文。许多行为表明缺乏足够的较长上下文后训练。

通过 QnABot,一个生成式 AI 聊天机器人,提供出色的对话体验来愉悦您的客户

AWS 上的 QnABot,一个 AWS 解决方案,现在提供与亚马逊 Bedrock 的无缝集成,提供对先进基础模型 (FMs) 和亚马逊 Bedrock 知识库的访问。这种集成使企业能够通过由自然语言理解 (NLU) 驱动的聊天机器人来增强客户体验,这些聊天机器人提供准确和上下文相关的响应。通过利用亚马逊 Bedrock 的 FMs,QnABot 可以生成用于语义问题匹配的文本嵌入,提高准确性并减少手动调优工作。此外,与亚马逊 Bedrock 知识库的集成允许从私有源检索特定数据,增强聊天机器人提供精确和相关答案的能力。此外,由亚马逊 Bedrock 的 LLMs 支持的 QnABot 的文本生成和查询消歧能力,使创建更具吸引力和类似人类的对话体验成为可能。这些能力最小化了广泛手动内容创建的需求,并提高了问题匹配的准确性,特别是在使用知识库或亚马逊 Kendra 回退功能时。

什么是 AI 代理,它们为什么重要?

GitHub 博客的文章探讨了 AI 代理在软件开发领域日益重要的作用,特别是那些由大型语言模型 (LLM) 驱动的 AI 代理。文章将 AI 代理比作扫地机器人,说明它们如何在最小监督的情况下自主执行任务并实现复杂目标。将 LLM 与外部工具(如 API)整合,显著增强了 AI 代理的能力,从而催生了 AutoGPT 和 GitHub Copilot 等先进的 AI 代理。文章还探讨了 AI 代理的技术方面,包括它们的规划、记忆和工具使用能力,同时也指出了调试和评估这些系统的挑战。GitHub 的项目,例如 Copilot Workspace,是 AI 代理如何简化开发流程并提高生产力的典范。

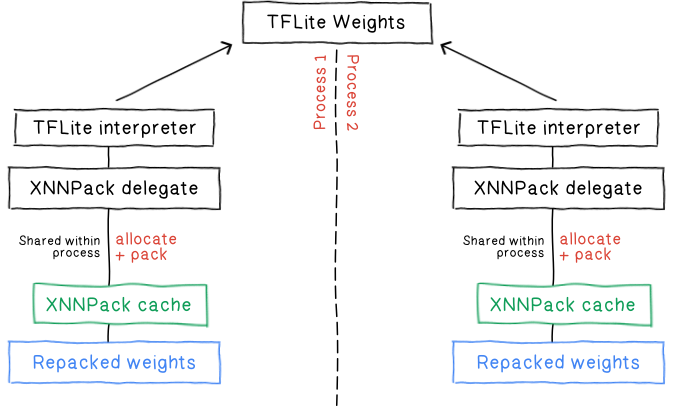

边缘推理优化:TensorFlow Lite 的 LLM 推理加速

来自 Google Developers 博客的文章详细介绍了 TensorFlow Lite (TFLite) 在边缘设备上优化大型语言模型 (LLM) 推理的最新进展。主要改进包括在 XNNPack 库中引入新的缓存提供者接口,显著提高了权重缓存效率。使用内存映射文件 (mmap) 进一步优化了性能,减少了启动延迟和峰值内存使用。这些改进实现了跨进程权重共享,简化了内存管理,并简化了用户体验。基准测试显示了各种模型的显著性能提升,突出了这些开发对于实时应用的重要性。

InfoQ 2024 年 AI、ML 和数据工程趋势

InfoQ 的 2024 年 AI、ML 和数据工程趋势播客由 Srini Penchikala 主持,邀请行业专家讨论 AI 和 ML 的最新发展。对话涵盖了向开源模型的转变、检索增强生成 (RAG) 的日益重要性以及小型语言模型和 AI 驱动的硬件的出现。小组成员还深入探讨了生成式 AI 的进步,特别是 ChatGPT 和 Google Gemini 的影响,并讨论了多模态模型的实际应用,尤其是 OCR 功能。此外,还重点介绍了关于更长上下文窗口与传统 RAG 方法的有效性之间的争论。

谷歌云 AI 夏季学习课程推荐

本文推荐了一套谷歌云 AI 课程学习路线图,旨在帮助开发者提升生成式 AI 技能。谷歌云技能提升提供了涵盖基础概念、高级 AI 工程和负责任 AI 开发等方面的课程和实验室。课程强调利用 Vertex AI、双子座和 Streamlit 等谷歌云工具进行实践操作。通过参与免费的谷歌云创新者计划,学习者可以获得学习积分和资源,以支持他们的学习之旅。

一夜之间,谷歌版 GPT-4o 和 AI 手机全上市了

谷歌在最新的 Made by Google 活动中,展示了其在 AI 技术和移动设备领域的全面布局和创新能力。活动中,谷歌发布了对标 OpenAI GPT-4o 的 Gemini Live,这是一款移动对话体验产品,允许用户与 AI 进行自由流畅的对话,支持多种自然声音选择,并能集成到多种安卓应用中。此外,谷歌还推出了一系列搭载全新 Tensor G4 芯片的 Pixel 硬件产品,包括 Pixel 9、Pixel 9 Pro 和 Pixel 9 Pro XL 等。这些设备不仅在性能上有所提升,还集成了多种生成式 AI 功能,如 Pixel Studio 的图像生成和 Pixel Weather 的 AI 天气报告等。新产品的发布不仅展示了谷歌在 AI 领域的技术实力,还可能推动未来移动设备向更智能和个性化的方向发展。

研究了 44 个 AI 产品,我发现了 AI 应用定价的秘密

本文由 Palle Broe 撰写,他曾在 Uber 和 Templafy 领导定价策略,并为多家科技初创公司提供货币化策略。文章通过研究 44 个原生 AI 应用的定价策略,探讨了 AI 功能的商业化方式,包括直接变现和间接变现。直接变现涉及对 AI 功能直接收费或提高产品价格,而间接变现则将 AI 功能集成到现有产品中而不改变价格。文章指出,大多数公司倾向于直接变现,因为这能更好地了解用户的支付意愿和 AI 功能的成本结构。此外,文章不仅分析了现有策略,还提出了新的定价模型和建议,为科技公司和创业者提供了宝贵的定价策略参考。

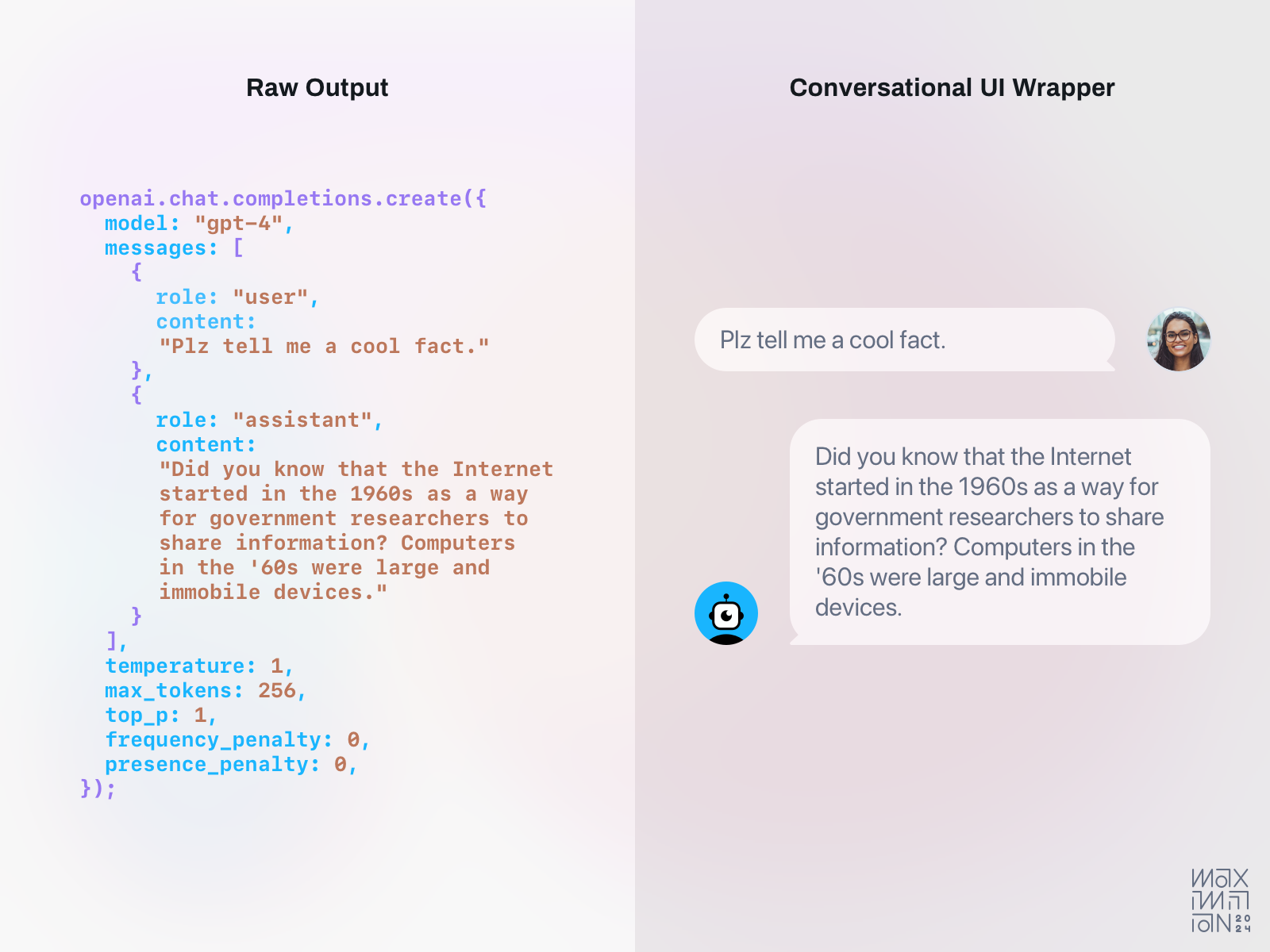

当语言无法描述:为超越对话式界面的人工智能设计

人工智能技术的发展推动着用户界面设计的演变,从图形用户界面 (GUI) 向更直观的对话式界面转变。然而,对话式界面并非适用于所有交互模式,存在局限性。生成式预训练模型 (GPT) 通过模式识别和数据处理改进对话式界面的性能,但仍面临实际应用中的挑战。界面设计应该回归基本的人机交互原则,例如可发现性、系统状态的可见性等,以确保用户体验的连贯性和有效性。

OpenAI 已投,大厂高管涌入,儿童陪伴正成为 AI 应用的下一个风口

AI 儿童陪伴市场潜力巨大,2023 年全球玩具市场规模达 1830 亿美元,且还在不断增长。儿童群体天然是 AI 最好的用户群体,对新交互方式接受度高,情感陪伴需求强烈。

硬件+多模态技术是这个领域产品落地的主流路径。硬件承载着情感价值,多模态技术(如语音交互)在儿童陪伴场景至关重要。生成式 TTS 技术在情感智能、回应非内容的声音、低延时等方面有巨大提升。

文章展示了 5 个 AI 儿童陪伴创业项目:Heeyo(家庭游戏生成器)、Zoetic(情绪丰富的电子猫头鹰)、跃然创新-BubblePal(让玩具开口说话)、FoloToy-Fofo(复制家长声音的火火兔)、亚马逊-Echo Pop Kids(可查聊天记录的智能音箱)。

代理的用户体验,第三部分:电子表格、生成式和协作式 UI/UX

本文重点介绍了三种新兴的 UI/UX 范例,包括电子表格、生成式和协作界面,并重点关注它们在 AI 智能体中的应用。电子表格界面提供了一种直观且用户友好的方式来支持批量工作负载,使智能体能够同时与多个智能体交互。生成式界面允许智能体生成原始组件以显示,提供完全控制,但可能导致质量差异。协作界面支持人类和智能体之间的协作,类似于 Google Docs,需要合并并发更改和总结智能体贡献的机制。

2000 万用户,Gamma 创始人:PPT 是痛点,但产品好才能解决痛点

Gamma 创始人 Grant Lee 和 Jon Noronha 分享了 Gamma 从初创到快速增长的历程,特别是 AI 技术如何改变产品体验和用户参与度。Gamma 成立于 2020 年,通过解决幻灯片制作的痛点,迅速从最初的 2000 个测试用户扩展到 2000 万用户。AI 功能的引入显著提高了用户的工作效率和创造力,并通过用户反馈不断迭代产品。Gamma 的成功展示了 AI 技术在优化产品和推动用户增长方面的强大作用。

全球最强 AI 程序员:GPT-4o 加持,需求到跑通只需 84 秒

Cosine 公司推出了自主 AI 工程师 Genie,该产品基于 OpenAI 的 GPT-4o 大型语言模型,能够自主完成代码编写、bug 修复、功能构建、代码重构和测试等任务,支持多种编程语言。Genie 在 SWE-Bench 基准测试中得分高达 30%,远超同类产品,成为全球性能最佳的 AI 程序员。该工具通过模拟人类工程师的认知过程,不仅提高了编程效率,还保障了代码安全。此外,Cosine 计划扩大模型组合并拓展到开源社区,进一步提升其产品的应用范围和影响力。

腾讯混元文生图开源模型上线三款 ControlNet 插件,让你精准控图

腾讯混元文生图开源大模型(HunyuanDiT)发布了三款新的 ControlNet 插件,包括 tile(高清放大)、inpainting(图像修复与扩充)、lineart(线稿生图)。这些插件与之前的官方插件一起构成了一个强大的 ControlNet 矩阵,覆盖美术、创意、建筑、摄影等多个领域,极大地提升了图像生成和编辑的精准度和灵活性。

社区供稿 | 开源 AI 视频工具,你只需要当导演,Hugging Face 工程师打造

Clapper 是一款开源的 AI 视频工具,旨在通过集成生成式 AI 技术,简化视频制作流程。用户无需直接编辑视频和音频文件序列,而是通过调整角色、位置、天气等抽象概念来创建视频。Clapper 由 Hugging Face 的 AI 前端工程师 Julian Bilcke 开发,其设计理念是让任何人都能通过交互式、迭代和直观的过程使用 AI 创建视频,无需外部工具或专业技能。

Clapper 目前已集成大模型,可将任意文本转换为时间线。在 GitHub 上,Clapper 已拥有超过 1100 个 Star,受到开发者和用户的欢迎。

爆火毒舌 AI 每小时赚 2.8 万!每分钟 36 个新用户,火遍全球只因改了一句提示词

- “毒舌 AI”Twitter 应用通过修改一句提示词,利用自然语言编程的优势,实现了多语言支持,从而在全球范围内迅速传播。

- 该应用基于低代码开发平台 Wordware 构建,降低了技术门槛,使非技术人员也能轻松创建复杂的 AI 应用。

- 开发者通过开源代码和提示词,鼓励社区参与和创新,推动了应用的持续发展。

- 应用采用灵活的商业模式,根据用户增长情况调整价格和付费策略,最大化收入。

- 通过根据不同地区消费能力调整价格,该应用成功覆盖了全球市场。

发现即修复:Copilot Autofix 使安全代码速度提升三倍

GitHub 博客文章宣布了 Copilot Autofix 的正式发布,这是一个 GitHub 高级安全 (GHAS) 中的 AI 驱动功能。该工具通过提供自动修复建议来解决修复代码漏洞的挑战,从而显著加快了这一过程。在公开测试阶段,Copilot Autofix 表明开发人员可以比手动方法快三倍以上的速度修复漏洞。该工具利用 CodeQL、GPT-4o 以及启发式方法和 GitHub Copilot API 的组合来生成准确有效的代码建议。它在减少 SQL 注入和跨站点脚本等常见漏洞所花费的时间方面特别有效。此外,Copilot Autofix 通过生成现有漏洞的修复来帮助管理安全债务,GitHub 计划将其扩展到开源项目,从而增强整个生态系统的安全性。

对话 AI 教育从业者们:AI 如何解决因材施教的难题?

AI 技术在教育领域的应用正蓬勃发展,通过提供个性化指导和智能辅助学习,能够有效解决因材施教难题。AI 原生学习机等产品通过实时生成互动式学习材料,帮助学生理解课堂内容。AI 原生学习机与传统自学型产品形成差异化优势,填补了关键的学习场景空白。AI 技术降低了短视频投放成本,促进了教育产品营销创新。AI 技术在教育领域的应用不仅提升了学习效率,更重要的是实现了教育的公平性,让更多学生受益。

AI 应用企业落地方法论:践行财务共享 AI 审单项目(第二篇)

本文是"AI 应用企业落地方法论"系列的第二篇,作者以亲身实践的 AI 审单项目为例,详细阐述了 AI 在企业落地的五步法。文章首先指出了企业应用 AI 的常见痛点,包括如何找到落地场景、如何评估投入产出比、如何理解 AI 技术、如何保障数据安全以及如何成功复制经验等。接着,文章重点介绍了第三步"流程设计与产品设计",包括 AI 成本最节约下的审单流程设计和对标工序和 ROI 的原型设计,强调了产品设计阶段对成本控制的重要性。此外,文章还介绍了速赢机会运营和全面推广的策略,以及对 AI 未来发展的展望。

“创业一年,人间三年”,李沐亲述 LLM 创业第一年的进展、纠结和反思

本文是李沐对创办 BosonAI 第一年的回顾与反思。他从决定创业的初衷谈起,分享了公司命名、融资历程、技术研发、商业模式探索等方面的心得体会。李沐详细描述了在有限资源下,如何带领团队克服技术难题,最终打造出在特定领域超越 GPT4 的定制化模型,并实现了公司第一年的收支平衡。他还深入剖析了对大语言模型发展趋势的四个阶段性认知,以及对未来“人类陪伴的智能体”愿景的思考。

3 万字圆桌实录:AI 崛起,新闻长存|仲夏六日谈

本文是《仲夏六日谈》节目的一部分,深入探讨了 AI 技术在新闻行业的应用及其对媒体形态、内容样式和用户关系的影响。文章指出,AI 技术,特别是大模型和 AIGC,正在改变媒体的内容形态、分发通路和交互方式。多模态和空间智能的发展将重新定义信息和媒体的呈现方式,影响内容创作和用户获取内容的方式。同时,传统媒体在转型过程中面临平衡现有业务与新兴业务的挑战,并通过优化顶层设计和组织管理来适应新的技术趋势。此外,文章讨论了推荐算法的局限性、AI 技术的未来发展趋势以及技术泡沫期对产业的影响,强调了在技术变革中如何保持对核心价值的坚守。

对谈汪华:AI 有 50% 几率成就十倍移动互联网的机会

汪华是一位具有远见卓识的投资人,他从 2009 年开始参与创新工场的创立,并早期就看到了移动互联网的投资机会。在这次对谈中,汪华将 AI 与移动互联网进行了比较,探讨了 AI 发展的机会和演进路线,同时也讨论了 AI 和一级市场面临的问题。他指出,AI 的发展可能会经历从 2B 方向到生产力工具,再到社交娱乐类产品的多个阶段。汪华认为,尽管 AI 在一开始就取得了超出其应有阶段的热度,但其实际的技术成熟度还不如 2010 年。他预测,如果 AI 能够实现复杂任务的自动化,那么它将是十倍于移动互联网的机会。汪华对 AI 的未来持乐观态度,认为尽管目前大家对 AI 的态度又开始悲观,但这只是暂时的降温,类似于移动互联网曾经经历过的阶段。

张鹏对话夏勇峰:使用时长超过 5 小时的 AI 硬件,才能留在牌桌上

本文记录了蜂巢科技创始人夏勇峰与极客公园创始人张鹏关于 AI 硬件发展趋势的深度对谈。

- 夏勇峰认为 AI 眼镜将成为取代手机的下一代智能终端,并将在未来 3-4 年内迎来爆发式增长,最终取代传统眼镜。

- 他强调 AI 硬件设计应关注用户长时间佩戴需求,并找到手机、笔记本电脑等现有设备之外的使用场景。

- AI 音频眼镜是蜂巢科技现阶段重点布局的产品,它主打长时间佩戴舒适性和 AI 功能,并将在未来加入更多传感器和 AI 应用,例如 AI 通知播报、AI 短音频内容生成等。

- 文章还探讨了 AI 硬件市场竞争、技术发展趋势以及创业公司面临的挑战,认为未来 AI 硬件市场竞争将异常激烈,考验的是团队的资源整合能力、对 AI 和硬件的理解,以及组织效率。

3 万字圆桌实录:有关具身智能的 10 个真问题|仲夏六日谈

《仲夏六日谈》节目中,专家们围绕具身智能的多个方面进行了深入讨论,包括其定义、与传统 AI 的区别、在家庭和工业中的应用挑战、以及商业化前景。具身智能被定义为赋予机器人身体智能,使其能在物理世界中执行任务,并通过交互提升智能,强调了具身智能的执行力、生长性和个性化服务。文章还探讨了具身智能在家庭端场景的挑战和商业化的难点,以及具身智能发展的核心瓶颈和未来突破方向。例如,节目中展示了机器人如何通过模仿学习和强化学习来完成家庭服务任务,但也指出了当前机器人技术在泛化能力、安全性等方面的局限性。专家们认为,具身智能的发展需要强大的数据支持、硬件成本的降低以及算法的进一步突破,才能真正走进千家万户。

谷歌前 CEO 埃里克·施密特最新论 AI 崛起, 全球竞争与科技演变· 万字全文(附视频)

谷歌前 CEO 埃里克·施密特在斯坦福课堂访谈中,就人工智能的未来发展、全球科技竞争以及 AI 对社会的影响等议题发表了深刻见解。他预测,未来一到两年内,上下文窗口扩展、AI 代理和文本到操作的结合将带来革命性突破,其影响力将远超社交媒体。施密特认为,美国和中国将成为 AI 领域的领 导者,但美国需要持续巨额投资并加强与盟友的合作,以保持其竞争优势。此外,他还探讨了 AI 对劳动力市场、软件开发模式以及国家安全的潜在影响,强调了政策监管和伦理规范的重要性。施密特还对 AI 技术的快速发展表示担忧,认为巨额投资可能会导致技术垄断和社会不平等问题,需要全球合作应对挑战。

红杉资本合伙人 David Cahn 八月访谈 3 万字完整版(附视频)

红杉资本合伙人 David Cahn 在访谈中详细讨论了人工智能行业的多个关键方面,包括数据中心的重要性、资本支出的战略意义、风险投资的挑战与机遇、以及人工智能对社会运作方式的深远影响。他强调了数据中心作为新工业革命核心的地位,以及资本支出在维持技术领先地位中的必要性。此外,Cahn 还讨论了人工智能可能导致权力集中和寡头垄断的问题,以及数据中心建设和模型效率的挑战。他还提到了人工智能在软件公司中的应用、定价权、垂直整合以及大型科技公司在人工智能领域的发展策略。最后,Cahn 探讨了人工智能领域的竞争态势,特别是大公司与小公司之间的差异,以及数据、计算和算法在人工智能发展中的作用。

C.AI 卖身真相:好技术,好方向,「坏」产品

C.AI 作为 AI 陪聊领域的先驱,凭借其独特的技术和产品,迅速积累了庞大的用户群体,日活用户高达 600 万,平均用户时长达 2 小时。然而,其高昂的运营成本和创始人 Noam Shazeer 对 AGI 的最终追求,使得 C.AI 面临着商业化困境,最终选择与 Google 达成协议,部分团队加入 Google,Google 则向 C.AI 投资方提供高额回报。此次收购不仅是 Google 对 AI 人才的渴望,更是其重构搜索和广告业务,以应对 AI 时代变革的重要一步。C.AI 的案例也引发了业界对 AI 产品商业化、成本控制、模型选择以及 AI 技术在情绪价值和内容消费领域应用的深入思考。